Top 7 sai lầm thường gặp khi xử lý Big Data

18 phút đọc Khám phá 7 sai lầm phổ biến khi xử lý Big Data ảnh hưởng tới cuộc sống hiện đại. (0 Đánh giá)

Top 7 Sai Lầm Thường Gặp Khi Xử Lý Big Data

Ngày nay, dữ liệu là tài sản quý giá nhất của mỗi doanh nghiệp. Khi thế giới ngày càng số hóa, khối lượng dữ liệu phát sinh mỗi ngày đã đạt tới quy mô “Big Data” – vượt ngoài khả năng quản lý của các công cụ truyền thống. Khai thác giá trị của Big Data giúp các tổ chức tiên lượng xu hướng, ra quyết định nhanh nhạy và tỏa sáng trên thị trường. Tuy nhiên, con đường biến dữ liệu lớn thành “vàng” không trải đầy hoa hồng như nhiều người tưởng. Mõ vàng của Big Data cuốn hút, nhưng cũng nhiều cạm bẫy. Ngay cả những chuyên gia dữ liệu dày dạn kinh nghiệm đôi khi cũng vấp phải những sai lầm phổ biến, dẫn đến dự án thất bại, chi phí tăng cao và quy trình đổ bể.

Trong bài viết này, chúng ta sẽ cùng phân tích kỹ lưỡng 7 sai lầm lớn nhất mà các tổ chức thường gặp khi triển khai Big Data, từ đó rút ra bài học và chiến lược phòng tránh thực tế để tối ưu giá trị dữ liệu lớn đem lại.

Không Định Nghĩa Rõ Ràng Vấn Đề Cần Giải Quyết

Một trong những sai lầm tốn kém nhất khi xử lý Big Data là lao vào thu thập dữ liệu, xây dựng hệ thống mà thiếu tầm nhìn rõ ràng hoặc mục tiêu kinh doanh cụ thể. Việc “chạy theo xu hướng” này dẫn đến nguồn lực bị phân tán, dữ liệu bị lãng phí và kết quả không phù hợp với nhu cầu thực tiễn.

Ví dụ thực tế:

Nhiều tổ chức đầu tư hàng tỷ đồng vào hạ tầng Big Data, xây dựng hệ sinh thái dữ liệu nhưng sau thời gian dài vẫn không biết khai thác dữ liệu để trả lời câu hỏi kinh doanh nào, hoặc thậm chí chưa xác định đúng vấn đề trọng tâm.

Lời khuyên có thể hành động:

- Phải luôn bắt đầu bằng câu hỏi: “Chúng ta muốn giải quyết vấn đề gì?” hoặc “Dữ liệu có thể giúp gì cho quyết định nào?”

- Xác định các chỉ số đo lường ảnh hưởng trực tiếp đến mục tiêu kinh doanh.

- Thường xuyên đối thoại giữa nhóm kỹ thuật & kinh doanh để đảm bảo “dữ liệu phục vụ mục tiêu, chứ không phải dữ liệu cho dữ liệu”.

Thu Thập Dữ Liệu Quá Rộng Mà Thiếu Kiểm Soát

Thu thập dữ liệu là khâu thiết yếu, nhưng sai lầm phổ biến là cố gom càng nhiều càng tốt mà không chú ý đến chất lượng, tính hợp lệ và mục đích sử dụng. Hệ quả là "data lake" (hồ dữ liệu) nhanh chóng biến thành "data swamp" (đầm lầy dữ liệu) – nơi dữ liệu bị lộn xộn, dư thừa và khó kiểm soát.

Phân tích chuyên sâu:

Trong lĩnh vực bán lẻ, công ty A thu thập mọi loại dữ liệu khách hàng (lịch sử mua hàng, hành vi trên mạng xã hội, tương tác website, cảm xúc, v.v.). Tuy nhiên, phần lớn dữ liệu thu thập được doanh nghiệp… không bao giờ dùng đến. Không những tăng chi phí lưu trữ, điều này còn làm phức tạp hoá việc phân tích và tốn nhiều thời gian làm sạch dữ liệu.

Mẹo hay phòng tránh:

- Đặt câu hỏi tối ưu hóa: Nếu thiếu ngân sách, dữ liệu nào có thể bỏ qua mà vẫn đảm bảo chất lượng phân tích?

- Thường xuyên đánh giá lại tiến trình thu thập và sẵn sàng loại bỏ những trường dữ liệu không còn đáp ứng mục tiêu đã xác định.

- Sử dụng sơ đồ luồng dữ liệu (data flow diagram) để thiết kế quy trình nhập liệu vừa tối giản, vừa hiệu quả.

Chưa Đầu Tư Đúng Mức Cho Bảo Mật Dữ Liệu

Khi khối lượng dữ liệu ngày càng lớn, trách nhiệm bảo mật dữ liệu càng tăng cao. Thực tế, nhiều doanh nghiệp chú trọng xử lý, phân tích mà bỏ qua khâu đảm bảo an toàn thông tin cá nhân (PII), tuân thủ các tiêu chuẩn như GDPR hay các quy định riêng từng quốc gia.

Góc nhìn chuyên sâu và ví dụ:

Các vụ rò rỉ dữ liệu nghiêm trọng gần đây ở ngân hàng, công ty tài chính đã minh chứng: chỉ một lỗ hổng nhỏ dẫn đến thông tin khách hàng bị đánh cắp, sẽ gây thiệt hại uy tín và tiền bạc khôn lường. Điều này nghiêm trọng hơn khi doanh nghiệp hợp tác với bên thứ ba/chuyên gia phân tích mà thiếu các biện pháp kiểm soát truy cập, phân quyền hoặc mã hóa dữ liệu thích hợp.

Giải pháp thực tế:

- Xây dựng nền tảng "Security by Design" từ đầu, không chỉ bổ sung vá lỗi về sau khi rắc rối xảy ra.

- Thường xuyên đào tạo nhân sự về nhận diện rủi ro liên quan tới dữ liệu lớn.

- Tích hợp kiểm tra an toàn bảo mật dữ liệu ngay trong các vòng phát triển sản phẩm (DevSecOps, Automation Security Test).

- Chủ động tuân thủ các chuẩn về bảo vệ dữ liệu (VD: ISO, GDPR, NIST).

Phân Tích Dữ Liệu Thiếu Chất Lượng và Làm Sạch Kém

Một bài toán phân tích dữ liệu sẽ không thể đưa ra kết quả đúng, nếu dữ liệu đầu vào đã bị lỗi, thiếu nhất quán hoặc chứa nhiều thành phần nhiễu loạn. Việc đầu tư nguồn lực vào làm sạch, chuẩn hóa dữ liệu – thay vì chỉ "bắt tay ngay" vào xây dựng mô hình – là bước nhiều tổ chức còn xem nhẹ.

Minh họa thực tế:

Công ty logistics B nhập dữ liệu vận đơn từ nhiều nguồn (app, email, phần mềm cũ), nhưng do các hệ thống khác định dạng, tên trường cũng khác nhau, kết quả là hàng ngàn mã vận đơn trùng lặp, hoặc thông tin không khớp. Nếu không chuẩn hóa và xử lý triệt để, các phân tích về hiệu suất giao hàng hoặc hành vi chậm trễ đều sai lệch.

Hướng dẫn nâng cao chất lượng xử lý dữ liệu:

- Xây dựng bộ quy tắc kiểm thử dữ liệu tự động trước và sau ETL (Extract, Transform, Load).

- Đầu tư vào thuật toán làm sạch sử dụng trí tuệ nhân tạo, phát hiện bất thường nâng cao.

- Quản lý meta-data, gắn nhãn chất lượng dữ liệu để truy xét nguồn gốc và độ tin cậy.

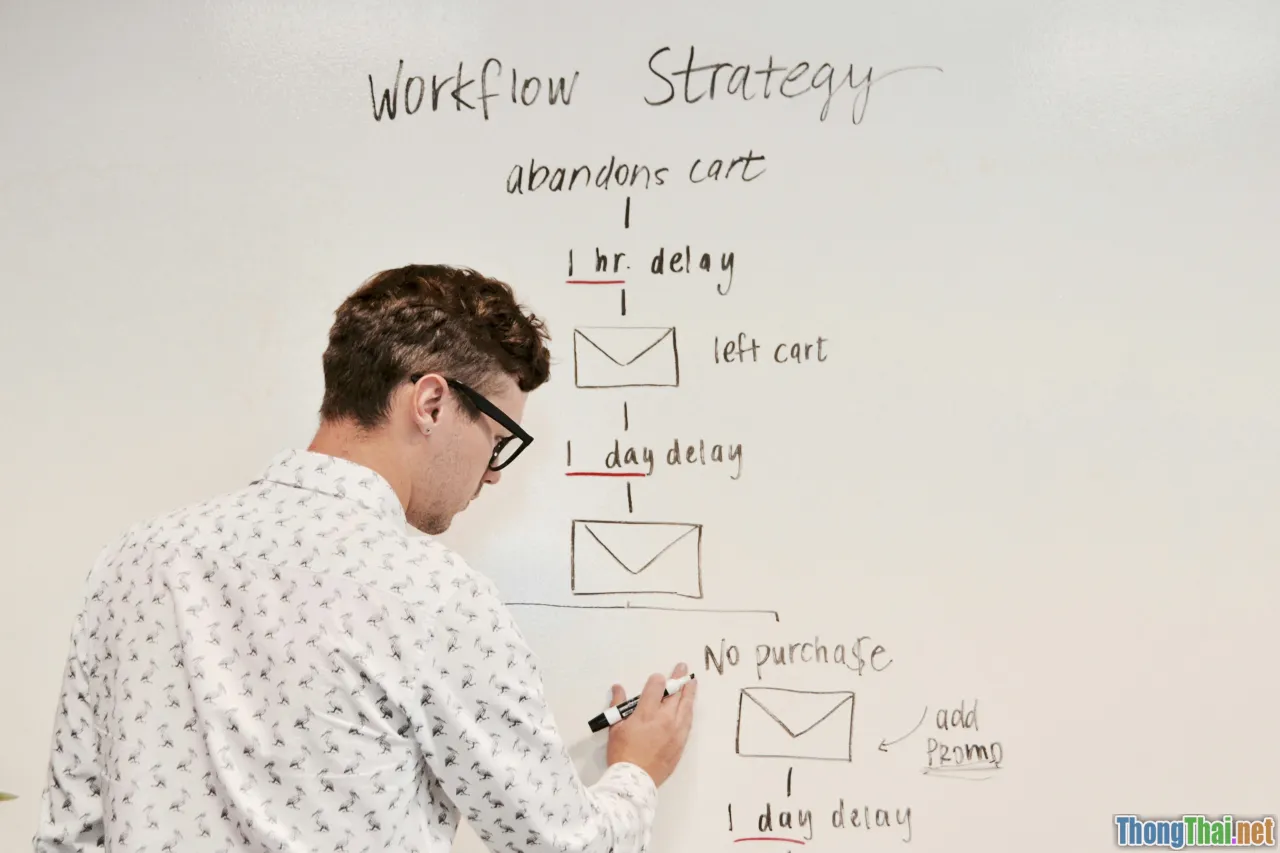

Thiếu Khả Năng Mở Rộng Về Hạ Tầng và Công Nghệ

Một sai lầm phổ biến khác là thiết kế hệ thống Big Data trên nền tảng hạ tầng truyền thống, thiếu tính linh hoạt khi nhu cầu hoặc khối lượng dữ liệu tăng đột biến.

So sánh cụ thể:

Tại nhiều doanh nghiệp, khi lưu lượng truy vấn và dữ liệu phát sinh tăng gấp đôi, hệ thống hiện tại bắt đầu "nghẽn cổ chai", phản hồi chậm, khiến các báo cáo dữ liệu trở nên vô dụng hoặc mất hàng giờ để tổng hợp. Những hệ thống này tránh chi phí phát sinh cho đến khi... không cứu vãn nổi.

Ngược lại, các nền tảng dữ liệu lớn triển khai trên cloud (AWS, Google Cloud, Azure) hoặc sử dụng công nghệ container (Kubernetes cluster) sẽ có tính mở rộng linh hoạt, trả phí theo mức sử dụng thực tế và đảm bảo hiệu suất.

Mẹo xây dựng kiến trúc linh hoạt:

- Ưu tiên thiết kế Modular: Các thành phần có thể nâng cấp, mở rộng hoặc thay thế riêng biệt (ví dụ chia frontend/backend/data pipeline riệng).

- Xây dựng kế hoạch “where to scale” sớm: xác định điểm sẽ gặp giới hạn của từng thành phần hệ thống khi dữ liệu lớn dần, từ đó chuẩn bị sẵn giải pháp phân vùng, tải phân tán hoặc cloud bursting.

- Tận dụng microservices, serverless hoặc Data Mesh lập trình dành riêng cho Big Data sẽ giúp hệ thống trường tồn theo thời gian.

Chủ Quan Với Thuật Toán/Phân Tích Mày Mò Sẵn Có

Rất nhiều dự án Big Data vấp phải sai lầm: sử dụng ngay các mẫu phân tích “out of the box” hoặc thuật toán có sẵn từ thư viện, mà không hiệu chỉnh hoặc xem xét phù hợp với tập dữ liệu riêng biệt của doanh nghiệp mình.

Phân tích chuyên sâu:

Điều này tương tự như mặc vừa một chiếc áo đo may sẵn vào một người có ngoại hình đặc biệt: gần như không bao giờ vừa! Một thuật toán dự báo tồn kho thành công với ngành thời trang chưa chắc đã phù hợp ứng dụng trong siêu thị mini hoặc nhà thuốc với hành vi khách hàng hoàn toàn khác biệt.

Nếu thiếu hiểu biết về đặc thù dữ liệu hoặc miền nghiệp vụ, kết quả phân tích sẽ dễ bị sai lệch, rơi vào tình trạng "biên dịch" mà không kiểm chứng thực tế.

Khuyến nghị:

- Luôn kiểm định (Validation) thuật toán/tiện ích phân tích dựa trên bộ dữ liệu riêng và mục tiêu kinh doanh thật.

- Chủ động tùy chỉnh mô hình, với các thông số phù hợp bối cảnh sử dụng.

- Kết hợp chuyên môn ngành với chuyên gia phân tích để thiết kế giải pháp “may đo” tối ưu, hạn chế tối đa rủi ro thiên vị (algorithm bias).

Bỏ Qua Văn Hóa Dữ Liệu và Đào Tạo Nhân Sự

Big Data không chỉ là câu chuyện về cá nhân hoặc bộ phận IT. Một sai lầm nguy hiểm ở mọi quy mô doanh nghiệp là không đầu tư xây dựng "văn hóa dữ liệu" – tạo ra tư duy dữ liệu ở mọi cấp, từ lãnh đạo tới nhân viên vận hành.

Góc nhìn và phép so sánh:

Dù có hệ thống dữ liệu mạnh tới đâu, nếu người dùng cuối/người ra quyết định không tin tưởng vào dữ liệu, hoặc không biết cách khai thác giá trị từ dữ liệu, toàn bộ dự án Big Data dễ trở thành "cỗ máy không người lái". Sự thành công của Amazon, Google hay Grab đến từ việc lực lượng đông đảo nhân viên đều am hiểu, tự tin triển khai và khai thác dữ liệu phục vụ công việc hàng ngày.

Hướng dẫn chuyển đổi thành công:

- Tổ chức workshop nội bộ, webinar về ý nghĩa, tiềm năng và thách thức khi xử lý dữ liệu lớn.

- Xây dựng hệ thống dashboard trực quan, giúp mọi phòng ban tiếp cận dữ liệu phù hợp với vai trò của mình.

- Thiết lập lộ trình học tập về data literacy (tư duy dữ liệu) cho toàn bộ nhân viên, thúc đẩy đổi mới sáng tạo dựa trên dữ liệu.

- Tạo môi trường trao đổi kiến thức liên ngành giữa chuyên gia dữ liệu và cán bộ vận hành.

Lời Kết: Đầu Tư Khoa Học Để Biến Dữ Liệu Lớn Thành Vàng

Big Data là “mỏ vàng” song cũng là “bãi mìn” tiềm ẩn đối với các tổ chức nếu không kiểm soát tốt 7 sai lầm cơ bản trên. Kỷ nguyên dữ liệu đòi hỏi doanh nghiệp phải vững vàng cả về chiến lược, quản trị, công nghệ lẫn văn hoá nhân sự để tránh mắc bẫy tốn kém, khai thác đúng mục tiêu và không ngừng tiến xa trên thị trường. Hãy kiên nhẫn đầu tư cho nền móng dữ liệu vững chắc, làm chủ công nghệ – nhưng đừng bao giờ quên sức mạnh thực sự của dữ liệu chỉ phát huy hiệu quả nếu gắn liền với tầm nhìn phát triển bền vững và đội ngũ sẵn sàng học hỏi, đổi mới từng ngày.

Hy vọng sau khi nhận diện, phân tích các sai lầm phổ biến và có thêm các chiến lược cụ thể ở trên, bạn đọc sẽ tự tin hơn khi triển khai hoặc tối ưu hoá các dự án Big Data tại tổ chức mình, tận hưởng trọn vẹn giá trị mà dữ liệu lớn mang lại.

Đánh giá bài viết

Đánh giá của người dùng

Bài viết phổ biến