NumPy và bí quyết tối ưu xử lý dữ liệu lớn

22 phút đọc Khám phá cách NumPy tối ưu hóa xử lý dữ liệu lớn trong lập trình hiện đại. (0 Đánh giá)

NumPy và bí quyết tối ưu xử lý dữ liệu lớn

Khởi nguồn từ nhu cầu số hóa dữ liệu khổng lồ trong các lĩnh vực như khoa học, tài chính, thương mại điện tử và trí tuệ nhân tạo, việc phân tích dữ liệu hiệu quả trở thành chén Thánh của thời đại số. Nhưng mọi chuyện không đơn giản với những dataset lên đến hàng triệu – thậm chí hàng tỷ – phần tử: hiệu suất hệ thống bị bóp nghẹt, chi phí tính toán đội lên, bộ nhớ quá tải. Đây là lý do NumPy – thư viện mảng nổi tiếng của Python – đã từ lâu trở thành "đầu tàu" trong thế giới xử lý dữ liệu lớn. Điều quan trọng không chỉ nằm ở sức mạnh mà NumPy mang lại, mà còn ở cách mà chúng ta khai thác và tối ưu hóa nó.

Nếu bạn từng mệt mỏi trước tiến trình chạy ì ạch, vắt óc giảm thời gian chờ đợi, hay đau đầu với lịch sử hoạt động của RAM – bài viết này là dành cho bạn! Hãy cùng nhau khám phá những bí quyết, những góc nhìn thực chiến, những mẹo tối ưu thật sự hiệu quả để đưa sức mạnh của NumPy lên tầm cao mới.

Thấu hiểu kiến trúc cốt lõi của NumPy

Điểm khởi đầu của mọi tối ưu hóa nằm ở việc hiểu sâu về cấu trúc dữ liệu bên dưới. NumPy không đơn thuần là một "mảng kiểu Python"; nó là khối mảng đa chiều (ndarray) được quản lý tối ưu về mặt memory và CPU.

1. Chế ngự bộ nhớ với dữ liệu liên tục (Contiguous Data)

Các array NumPy lưu trữ dữ liệu trong vùng bộ nhớ liên tục, đem lại lợi ích lớn về tốc độ truy xuất nhờ cơ chế cache của CPU. Khi làm việc với dữ liệu lớn, việc đảm bảo các thao tác không làm "vỡ" cấu trúc liên tục này sẽ tránh được sự suy giảm hiệu suất.

Ví dụ:

import numpy as np

A = np.arange(10_000_000)

A.flags['C_CONTIGUOUS'] # True nếu phân dải thành dòng bộ nhớ liên tục

Thực tiễn: Hạn chế dùng .transpose() hoặc slicing kiểu lạ khi không cần thiết, tránh để mảng trở thành phi liên tục (non-contiguous) sẽ khiến các phép toán chậm rõ rệt.

2. Dtype – Kích cỡ vừa đủ giúp bay như gió

Chọn đúng kiểu dữ liệu (dtype) cắt giảm khối lượng bộ nhớ và tăng tốc xử lý. Đừng để NumPy mặc định chọn kiểu dữ liệu "quá to" cho bài toán nhỏ.

Ví dụ:

large_ints = np.arange(1_000_000, dtype=np.int64)

# Nhưng nếu giá trị đủ nhỏ, dùng int8, int16 để nhẹ hơn:

small_ints = np.arange(1_000_000, dtype=np.int16)

Hãy dùng A.astype(np.float32) thay cho float64 nếu độ chính xác không cần tới!

Broadcasting: Vi diệu của toán tử vector hóa

"Broadcasting" là phép màu giúp NumPy xử lý khối lượng lớn dữ liệu mà không sinh ra các bản sao tốn kém. Bản chất là mở rộng một mảng nhỏ lên cùng hình dạng với mảng lớn để thực hiện các phép toán vector hóa.

Ví dụ cụ thể:

A = np.array([[1,2,3],[4,5,6]]) # shape (2,3)

B = np.array([10,20,30]) # shape (3,)

C = A + B # Broadcasting tự động!

Kết quả:

[[11 22 33]

[14 25 36]]

Broadcasting giúp né tránh loop chồng chất chậm chạp kiểu thuần Python:

result = []

for row in data:

result.append([x + y for x, y in zip(row, bias)]) # Quá tốn thời gian!

Nên biệt và khai thác triệt để khả năng broadcasting sẽ làm "dịch chuyển" năng lực xử lý dữ liệu lớn của bạn.

Chú ý

Broadcast không phải lúc nào cũng tiết kiệm RAM: Hãy theo dõi kích thước khi "trộn" nhiều chiều để tránh vô ý tạo ra mảng tường lớn bất ngờ.

Vectorization: Loại bỏ vòng lặp, tăng tốc xử lý

Vòng lặp truyền thống trong Python lề mề khó tránh, nhưng với NumPy, chúng ta có thể gần như "quên điểm yếu đó".

Thay vòng lặp bằng toán tử NumPy:

# Python thuần tốc độ thấp

out = np.zeros_like(arr)

for i, x in enumerate(arr):

out[i] = np.sin(x) + np.sqrt(x)

# NumPy cực nhanh

out = np.sin(arr) + np.sqrt(arr)

Không chỉ nhanh hơn mà còn đẹp hơn và dễ bảo trì.

Nâng tầm biểu thức với np.where, np.select, np.sum, v.v.:

Thay vì nhiều điều kiện lồng ghép, hãy dùng các hàm mạnh này:

arr = np.arange(10)

labels = np.where(arr % 2 == 0, 'even', 'odd')

Phép toán giảm chiều số lớn (np.sum, np.mean, ...):

Tận dụng tham số axis để giảm thiểu dữ liệu trên các chiều mà không cần làm thủ công.

m = np.random.rand(10000, 1000)

col_mean = np.mean(m, axis=0) # Lấy trung bình mỗi cột, cực nhanh và tiết kiệm RAM

Lưu ý thực tiễn: Phải hình dung kết quả đầu ra để tránh phát sinh mảng trung gian lớn, nhất là khi dữ liệu scale lên hàng GB.

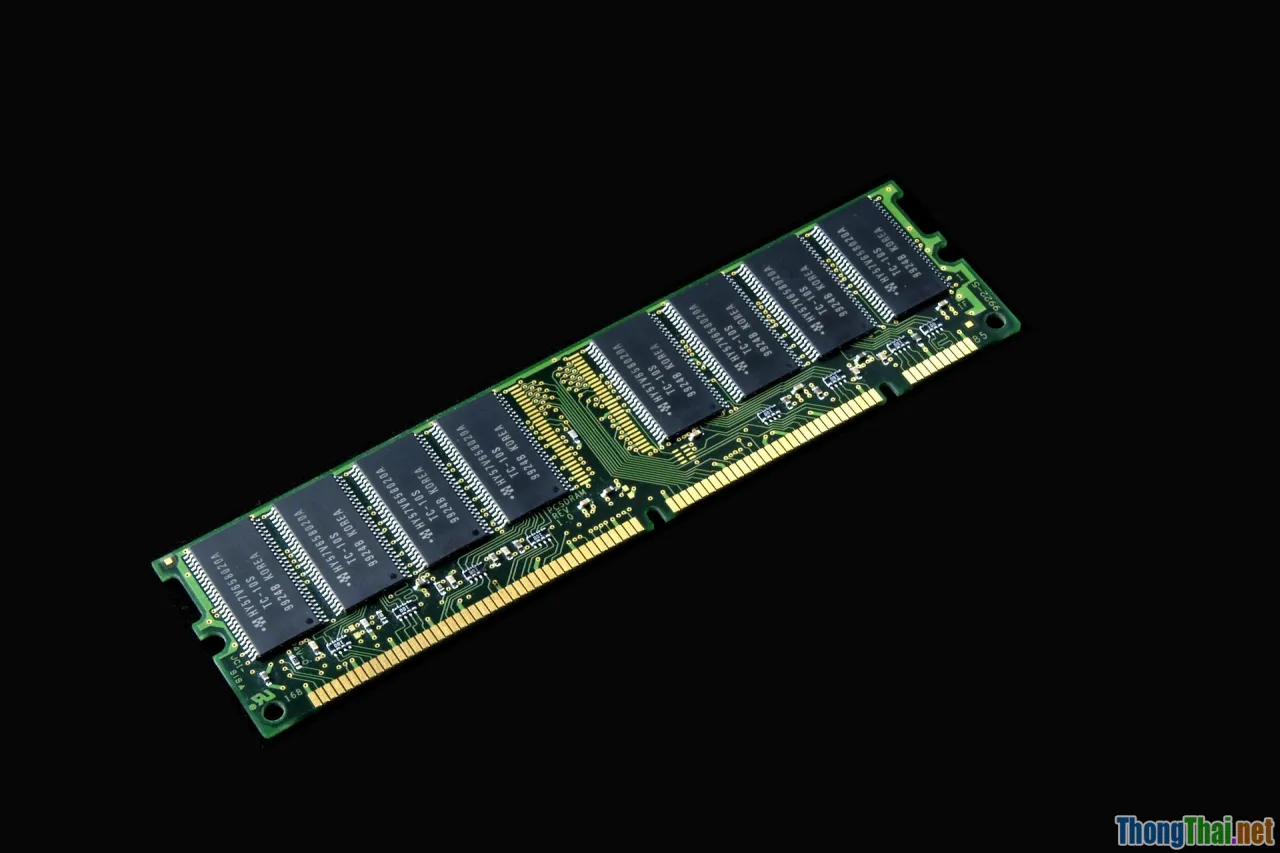

Memory Mapping: Khi dữ liệu lớn hơn cả RAM

Ở mức đặc biệt lớn, dataset vượt xa dung lượng RAM. NumPy cung cấp giải pháp memory-mapping, xử lý dữ liệu kiểu từng phần (on-demand) từ ổ cứng.

Cách dùng np.memmap: Hằng trăm GB dữ liệu thí nghiệm vật lý, ảnh vệ tinh, hoặc dữ liệu log hệ thống – hãy loading memmap như thao tác với một mảng thông thường mà không cần nạp toàn bộ lên RAM.

fp = np.memmap('bigdata.dat', dtype='float32', mode='r', shape=(1_000_000_000,))

print(fp[42]) # Truy xuất từng phần tùy ý

Ưu điểm:

- Giảm rõ rệt áp lực bộ nhớ

- Ít bị lỗi crash vì "quá tải RAM"

- Tương tác linh hoạt (slice, reshape, broadcasting v.v.)

Nhược điểm:

- Bị giới hạn tốc độ đọc/ghi đĩa (SSD giúp cải thiện đáng kể)

- Không dùng cho phép toán cần RAM nhất quán quá lớn

Khi nào nên dùng?

- Khi chỉ cần xử lý từng phần nhỏ (mini-batch, block xử lý song song)

- Khi cần streaming hoặc cập nhật/đọc phần dữ liệu theo thời gian thực

Chia nhỏ và batch: Phương thức khôn ngoan của dữ liệu siêu lớn

Thay vì xử lý trọn bộ dữ liệu, hãy chia thành batches (khối nhỏ), giúp:

- Tối ưu bộ nhớ

- Dễ song song hóa

- Cải thiện hiệu suất tổng thể, đặc biệt là với các mô hình học máy lớn

Ví dụ tạo batch với slicing:

array = np.random.rand(100_000_000) # Dữ liệu lớn

batch_size = 1_000_000

for start in range(0, len(array), batch_size):

batch = array[start:start+batch_size]

process_batch(batch)

Tham vọng one-shot (xử lý cả khối lớn) dễ dẫn tới hiện tượng thrashing bộ nhớ hoặc crash hệ thống. Hành động linh hoạt với batch là bí quyết sống còn trong thực tế.

Song song hóa: Máy tính mạnh luôn không đủ?

Dù NumPy đã vector hóa, nhưng nếu một phép toán "quá khủng", chúng ta có thể song song hóa thêm với nhiều nhân CPU.

Dùng các hàm NumPy hỗ trợ song song (nội bộ)

Một số hàm giảm chiều như np.sum, np.mean trên mảng lớn đã tích hợp khả năng chạy đa luồng (multithread). Bạn có thể điều chỉnh biến môi trường OMP_NUM_THREADS, MKL_NUM_THREADS để dùng toàn bộ sức mạnh CPU:

export OMP_NUM_THREADS=4

export MKL_NUM_THREADS=4

Ngoại vi: chia nhỏ mảng và tính toán song song với multiprocessing

Python chuẩn có module multiprocessing;

bạn có thể dễ dàng phân chia từng batch để các tiến trình độc lập đảm nhận:

from multiprocessing import Pool

def f(chunk):

return np.sum(np.sqrt(chunk))

data = np.random.rand(10_000_000)

chunks = np.array_split(data, 4)

with Pool(4) as p:

results = p.map(f, chunks)

final_result = np.sum(results)

Lưu ý, việc song song hóa hiệu quả hơn khi mỗi batch là khá lớn, tránh "overhead" chia tách nhiều mảnh vụn nhỏ.

Cân nhắc tối ưu hoá bộ nhớ cache (Cache Efficiency)

Hiệu suất memory cache là bí quyết của các máy xử lý dữ liệu lớn chuyên nghiệp. Với NumPy, bạn nên:

- Sắp xếp truy xuất theo thứ tự liên tục ("row-major" cho

C_CONTIGUOUShoặc "column-major" choF_CONTIGUOUS) - Tránh truy cập mảng phi liên tục (bằng

arr.T, transpose nhiều lần) hoặc slicing khó kiểm soát

So sánh hiệu suất:

A = np.random.rand(10000, 10000)

%timeit np.sum(A, axis=1) # Nhanh hơn

%timeit np.sum(A, axis=0) # Có thể chậm hơn trên mảng row-major

Hiểu cách bộ nhớ tổ chức giúp định hướng chọn chiều nào để "sum" hoặc "mean" cho tối ưu hóa tốc độ.

Với dữ liệu cực lớn, thậm chí chỉ cần đảo chiều tiếp cận cũng mang lại khác biệt lớn về mặt hiệu năng.

Tránh lưu trữ trùng lặp và mảng trung gian không cần thiết

Ở dự án lớn, ngập tràn bộ dữ liệu, nguy cơ tạo ra các bản sao trung gian "cồng kềnh" là rất cao. Để tránh điều này:

- Luôn cân nhắc dùng

in-placenếu không cần giữ lại dữ liệu cũ:arr.sort() # Sắp xếp trực tiếp thay vì tạo bản sao mới np.add(arr1, arr2, out=arr1) # Ghi đè kết quả vào arr1 - Tránh chuỗi nhiều phép toán không cần thiết. Ví dụ, thay vì:

=> Hãy dùng:arr2 = arr1 * 2 arr3 = arr2 - 1 arr4 = np.sqrt(arr3)arr4 = np.sqrt(arr1 * 2 - 1) - Với những phép toán lớn, cân nhắc giải phóng RAM tạm khỏi các biến không còn sử dụng (

delhoặc dùnggc.collect()); - Theo dõi bộ nhớ bằng

sys.getsizeof,nbytes, hoặc tận dụng thư viện nhưmemory_profilerđể chủ động kiểm soát.

Sparse arrays – Tận dụng "rỗng" cho dữ liệu siêu lớn

Có vô số tình huống mà 99% giá trị là 0 (ma trận thưa, biểu diễn văn bản, one-hot, ...). Dùng mảng dày đặc (dense array) sẽ lãng phí RAM phi lý. Hãy chuyển sang dùng sparse array từ scipy.sparse.

Ví dụ lưu trữ và xử lý ma trận cực thưa:

from scipy import sparse

sparse_mat = sparse.csr_matrix((data, indices, indptr), shape=(1000000,1000000))

**Tác dụng: **

- Tiết kiệm cực lớn bộ nhớ cho các bài toán ma trận lớn

- Nhiều phép toán nhân, cộng ma trận hỗ trợ trực tiếp

Chú ý: Sparse không nên cho bài toán có mật độ non-zero cao (>10–20%), lúc này dense array sẽ tối ưu hơn.

Tậu "vũ khí" nâng cao: Cython, Numba, và BLAS tối ưu hóa

NumPy rất nhanh – nhưng đôi lúc bạn cần "vũ khí hạng nặng" để chạm ngưỡng hiệu suất cao hơn mới đáp ứng bài toán thực tế.

Numba

Đây là thư viện JIT compilation tối ưu hàm thuần NumPy/Python ở cấp độ máy tính:

from numba import njit

@njit

def power_sum(arr):

total = 0.0

for x in arr:

total += x**2

return total

Không cần thay đổi code NumPy, chỉ việc "@njit" vào sẽ tăng tốc xử lý lên gấp nhiều lần nếu bạn có nhiều vòng lặp "bất khả vector hóa".

Cython

Cho phép "pythonize" thao tác C, khai báo kiểu biến cố định, cực hữu ích cho những trường hợp phức tạp chưa vector hóa được. Hãy đầu tư thời gian "cải đạo" các đoạn code chậm nhất.

BLAS, MKL, OpenBLAS

Đây là những thư viện nền tăng tốc phần cứng nhiều thao tác nội bộ NumPy. Đảm bảo cài đặt NumPy phiên bản đã build với BLAS sẽ thấy phép nhân, cộng, luỹ thừa ma trận lớn tăng sức mạnh vượt bậc!

Kiểm tra hiệu suất BLAS:

import numpy as np

np.show_config() # Kiểm tra liên kết BLAS/MKL

Mỗi nền tảng sẽ có "khẩu pháo" BLAS riêng, chủ động tối ưu hóa trong cài đặt để khai thác triệt để phần cứng là lợi thế cực lớn (đặc biệt khi làm việc tập trung với dữ liệu, thuật toán học máy quy mô cực đại).

Lời khuyên chuyên gia: tinh chỉnh, theo dõi, dự báo hiệu suất

Đo lường chứ không đoán mò

Hãy "profiling" nghiêm ngặt bằng cProfile, line_profiler cho từng hàm lớn, bố trí thử nghiệm với dữ liệu giả lập tương đương thực tế. Khi nào chậm? Chậm do bước nào? Đừng tối ưu "cảm tính".

Quản lý tài nguyên tập trung

Chia sẻ máy với người khác (hạ tầng cloud/shared server)? Luôn hỏi:

- Tổng RAM còn lại?

- Số nhân CPU mình được cấp?

- Ổ SSD/HDD?

Tối ưu chưa bao giờ là vụ "quăng code lên" và chờ phép màu.

Liên tục cập nhật

NumPy, SciPy, và thế giới Python luôn biến động (mỗi bản release lại tăng performance hoặc bổ sung tính năng tối ưu hóa). Đừng quên đọc changelog, test lại code định kỳ với bản mới nhất.

Đầu tư tối ưu ở những mắt xích "nghẽn cổ chai" (bottleneck)

Không cần "overengineering" cho bước đã tốt. Hãy tập trung tối ưu thuật toán/mảng nào chiếm nhiều thời gian nhất, giám sát qua các công cụ profiling trước khi sửa.

Quản trị dữ liệu lớn thời hiện đại là trận chiến liên tục với hiệu suất và tài nguyên. Dưới lớp vỏ "thư viện tiện ích" của Python, NumPy mang trong mình đầy đủ sức mạnh để vượt qua các thách thức nan giải của xử lý dữ liệu khổng lồ – nếu bạn nắm trong tay những bí quyết tối ưu chuẩn xác! Hiểu cốt lõi kiến trúc, vận dụng thông minh kỹ thuật vector hóa, broadcasting, memory-mapping, song song hóa đúng lúc, loại bỏ lãng phí của bộ nhớ; thậm chí, trang bị thêm các vũ khí tăng tốc với Numba, BLAS, Cython…

Cuối cùng, sức mạnh thật sự của NumPy không chỉ nằm ở các lệnh gõ ra, mà ở khả năng tư duy chiến lược khai thác mềm dẻo các tuyệt chiêu trên, đưa phân tích dữ liệu lớn lên tầm cao hiệu quả, linh hoạt, bứt phá mọi rào cản của thời đại số. Đừng chỉ làm chủ "dữ liệu lớn" – hãy làm chủ cách TỐI ƯU nó cùng NumPy!

Đánh giá bài viết

Đánh giá của người dùng

Bài viết phổ biến